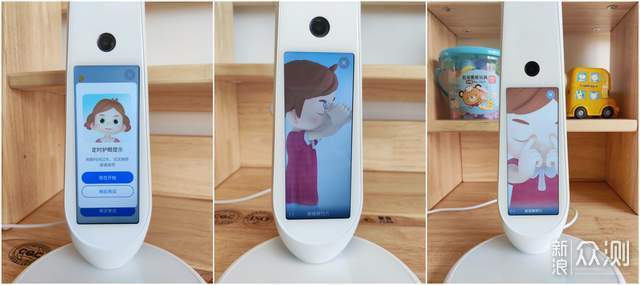

你是否也遇到过这样的情况:给孩子买的AI学习助手台灯,号称能实时监测坐姿、识别书本内容、语音互动,可稍微离网就变“智障”,响应延迟明显,甚至隐私数据上传云端让人不安。作为技术学习者,我们往往“会用但不懂原理”:端侧AI为什么能在低功耗芯片上跑复杂模型?模型量化到底损失多少精度?面试时被问到“AI学习助手台灯如何实现离线推理”,更是一头雾水。本文将从端侧AI推理与模型轻量化技术入手,配合极简代码示例与高频面试题,由浅入深拆解AI学习助手台灯背后的核心逻辑,帮你建立完整知识链路。

一、开篇引入

在智能硬件领域,AI学习助手台灯已成为边缘计算落地的典型场景——它需要在有限算力、电池供电、实时响应的约束下完成视觉检测、语音唤醒、语义理解等任务。端侧AI推理(On-Device AI Inference)与模型轻量化技术正是解决这一矛盾的关键。本文不仅讲解二者的定义与关系,更会通过代码对比、底层原理分析和面试实战,让你彻底搞懂“台灯大脑”的工作方式。后续系列还会深入语音前端算法与多模态融合,欢迎持续关注。

二、痛点切入:为什么需要端侧AI

传统实现AI学习助手台灯功能的方式,通常将摄像头/麦克风数据上传云端处理:

传统云端识别流程(伪代码) def detect_bad_posture(image): upload_to_cloud(image) 上传图片,耗时100~200ms result = poll_cloud_api() 等待云端推理结果 return result 依赖网络,隐私风险高

缺点暴露:

高延迟:往返网络+云端排队,坐姿纠正滞后,失去实时性

依赖网络:断网时所有AI功能失效,沦为普通台灯

隐私风险:家庭环境视频数据上传,用户顾虑大

带宽成本:海量设备持续上传,服务器压力巨大

设计初衷:把AI推理从云端迁移到台灯本地芯片上,实现低延迟、离线可用、数据不出设备——这就是端侧AI推理技术诞生的直接动力。

三、核心概念讲解(概念A:端侧AI推理)

端侧AI推理(On-Device AI Inference)指在终端设备(如台灯内的ARM CPU、NPU)上直接运行训练好的机器学习模型,完成前向计算并输出结果,无需与云端交互。

关键词拆解:

端侧:数据采集与计算在同一物理设备完成

推理:仅执行前向传播(Forward Pass),不涉及反向训练

生活化类比:

传统云端AI像“打电话问专家”——每次都要拨号、等待接通、描述问题、得到答案;端侧AI像“把专家请回家”——专家常驻台灯内,你一问他就答,实时且私密。

作用与价值:

响应速度从秒级降至毫秒级(如坐姿检测<30ms)

断网可用,提升产品可靠性

原始数据不离设备,满足GDPR等隐私合规要求

四、关联概念讲解(概念B:模型轻量化技术)

模型轻量化技术(Model Lightweighting)是一组通过压缩、剪枝、量化、蒸馏等手段减少模型参数量和计算量的方法集合,目的是让原本需要GPU服务器运行的模型能够在端侧芯片上实时推理。

与概念A的关系:

模型轻量化是实现端侧AI推理的具体手段。没有轻量化,大模型塞不进台灯的嵌入式芯片;只有轻量化而仍在云端跑,也不算端侧推理。

与概念A的差异:

| 维度 | 端侧AI推理 | 模型轻量化 |

|---|---|---|

| 本质 | 部署范式 / 运行位置 | 模型压缩技术集合 |

| 关注点 | 在哪里算、如何低延迟 | 怎么把模型变小变快 |

| 是否可独立存在 | 可以(如果原始模型足够小) | 可以(轻量化后的模型仍可部署在云端) |

简单示例:

一个ResNet50图像分类模型原始体积98MB,在台灯Cortex-M55上无法实时运行。通过8-bit量化(轻量化技术)压缩到25MB,再部署到端侧推理引擎(如TensorFlow Lite Micro),即可流畅运行——前者是“手段”,后者是“目标位置”。

五、概念关系与区别总结

逻辑关系:端侧AI推理是“战略目标”,模型轻量化是“战术武器”。先确定要离线推理,再选用量化/剪枝等技术实现。

一句话概括:没有模型轻量化,端侧推理只是空想;没有端侧推理的需求,轻量化也失去了边缘落地的核心场景。

易混淆点提醒:不要认为“量化后的模型就一定跑在端侧”——量化也能加速云端推理;同样,“端侧推理”也可以运行未量化的模型(若芯片算力足够)。二者是互补而非绑定的关系。

六、代码 / 流程示例演示

以下演示一个AI学习助手台灯坐姿关键点检测的极简流程:传统云端方式 vs 端侧量化推理方式。

环境假设:台灯内置Linux板卡(如RV1126),已安装TFLite Runtime。

端侧量化推理示例(使用TensorFlow Lite) import tflite_runtime.interpreter as tflite import cv2 import numpy as np 1. 加载量化后的姿势检测模型(轻量化产物) interpreter = tflite.Interpreter(model_path="pose_quantized.tflite") interpreter.allocate_tensors() input_details = interpreter.get_input_details() output_details = interpreter.get_output_details() 2. 摄像头捕获一帧(640x480) cap = cv2.VideoCapture(0) ret, frame = cap.read() input_data = cv2.resize(frame, (224, 224)) 模型输入尺寸 input_data = np.expand_dims(input_data, axis=0).astype(np.uint8) 量化模型输入为uint8 3. 端侧推理(耗时<20ms) interpreter.set_tensor(input_details[0]['index'], input_data) interpreter.invoke() 关键调用:执行前向计算 output = interpreter.get_tensor(output_details[0]['index']) 4. 解析关键点坐标,判断是否低头 shoulder_y = output[0][5] 假设第5个关键点为肩部y坐标 if shoulder_y > 180: print("警告:低头过度,请调整坐姿") 台灯蜂鸣或调亮灯光

对比传统云端流程:

云端需要cv2.imencode+requests.post+JSON解析,耗时150~300ms且必须联网。端侧方案去掉网络往返,代码中interpreter.invoke()直接在本地NPU完成矩阵运算,数据0暴露。

执行流程解释:

① 摄像头采集原始图像 → ② 预处理缩放至模型输入尺寸 → ③ 调用端侧推理引擎执行卷积/池化计算 → ④ 输出关键点坐标 → ⑤ 业务逻辑判断。整个过程不离开本地硬件。

七、底层原理 / 技术支撑点

端侧推理引擎(如TFLite Micro、NCNN)之所以能高效运行,底层依赖三大支柱:

硬件指令集与并行计算

ARM Cortex-M内核的SIMD指令(如NEON)可一次性处理4个float32数据;NPU则更进一步,采用脉动阵列(Systolic Array)对卷积运算进行流水线优化。内存复用与算子融合

推理引擎将连续的内存块预分配,避免动态分配开销;同时将Conv+BN+ReLU三个算子融合成一个计算核,减少中间张量的读写。模型量化中的整数运算

将float32权重和激活值映射到int8范围,前向计算全部转为整数乘加(如int8 int8 -> int32),再反量化回输出。这利用了CPU对整数运算的更高吞吐量(2~4倍于浮点)。

后续进阶内容会深入讲解:如何针对台灯的NPU编写自定义算子,以及Post-training Quantization与Quantization Aware Training的精度差异。

八、高频面试题与参考答案

问题1:请解释端侧AI推理与传统云端推理的核心区别,并说明AI学习助手台灯为什么需要端侧推理。

参考答案:

区别:端侧推理在设备本地完成前向计算,不依赖网络;云端推理需上传数据至服务器。端侧延迟低(毫秒级)、保护隐私、离线可用;云端模型可以更大,但延迟高(百毫秒级+网络抖动)。

台灯场景要求实时纠正坐姿(<50ms)、家庭隐私敏感、可能处于断网环境,因此必须采用端侧推理。

问题2:模型量化(Quantization)的原理是什么?精度损失一般控制在多少?

参考答案:

原理:将浮点数值(FP32)映射到更小位宽(如INT8)的离散整数空间,推理时使用整数运算,最后反量化回浮点。常用映射公式:

q = round(r / scale + zero_point)。精度损失:在图像分类任务上,INT8量化通常损失1%~2%的top-1准确率;对于姿态检测等回归任务,关键点像素误差增加约0.5~1.0像素,人眼基本无感。

问题3:在资源受限的台灯主控上,除了模型量化,还有哪些模型轻量化手段?

参考答案:

结构化剪枝(去除不重要的卷积通道)

知识蒸馏(用小模型模仿大模型输出)

神经结构(NAS)自动寻找高效网络如MobileNetV3

权重共享(如SqueezeNet的fire module)

踩分点:至少说出两种,并简要说明原理。

问题4:端侧推理引擎如何处理动态输入尺寸(例如台灯识别不同距离的书本)?

参考答案:

常用方案:固定模型输入尺寸(如224x224),对原始图像做等比例缩放+letterbox填充。

高级方案:使用全卷积网络(FCN)支持任意尺寸输入,但会增加推理引擎实现复杂度。

实际工程中,多数AI学习助手台灯采用第一种方案,因为NPU对固定尺寸的算子优化最好。

问题5:请你从系统架构角度,画出台灯从摄像头采集到语音提示的完整AI处理流水线(口述)。

参考答案:

① 摄像头/麦克风驱动层获取原始数据 → ② 预处理(缩放、归一化、去噪) → ③ 端侧推理引擎加载轻量化模型并执行 → ④ 后处理(NMS、坐标解析、置信度过滤) → ⑤ 业务逻辑决策(坐姿/光线/语音意图) → ⑥ 执行器(喇叭、LED灯、屏幕)反馈。关键点:每个环节都要控制总延迟在实时阈值内(如<100ms)。

九、结尾总结

本文以AI学习助手台灯为实体场景,系统梳理了端侧AI推理(部署范式)与模型轻量化(技术手段)的核心概念、逻辑关系及落地实践。重点回顾:

痛点驱动:云端方案延迟高、依赖网络、隐私风险 → 催生端侧推理

概念区分:端侧推理是“在哪里算”,轻量化是“怎么变小算快”

代码实战:量化模型 + TFLite 实现本地坐姿检测,对比云端流程突出优势

底层原理:SIMD指令、算子融合、整数运算

面试考点:端云对比、量化原理、轻量化手段、实时流水线

易错点提醒:不要混淆量化和剪枝的作用域;不要认为端侧推理必须配合轻量化(低算力场景才需要)。下一篇将深入AI学习助手台灯中的语音唤醒算法,讲解如何在MCU上实现“小雅小雅”低功耗检测,敬请期待。

扫一扫微信交流

扫一扫微信交流